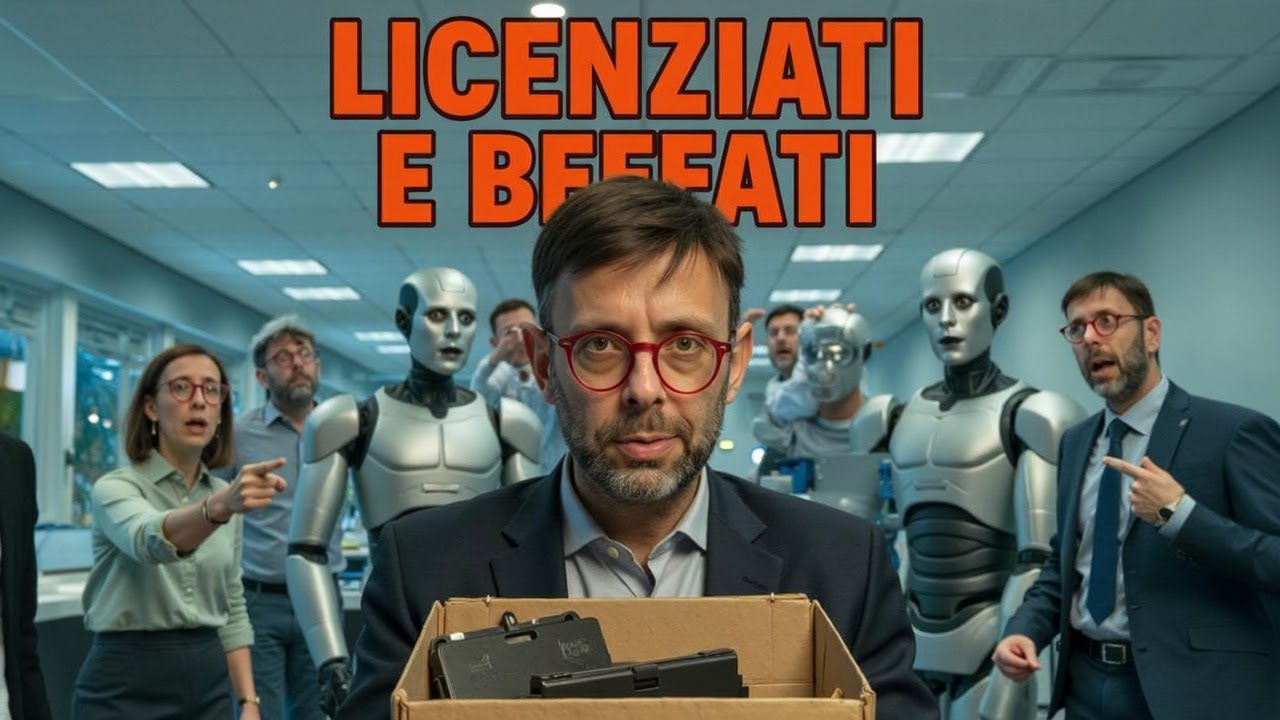

Matt Turnbull, executive producer di Xbox, ha scatenato un putiferio su LinkedIn suggerendo alle 9000 persone licenziate da Microsoft di affidarsi all'intelligenza artificiale per superare il trauma del licenziamento. Una lista di prompt AI per riformulare il curriculum e recuperare la chiarezza emotiva ha suscitato reazioni fortemente negative, evidenziando la mancanza di empatia e intelligenza emotiva. Il post è stato rapidamente rimosso, ma ha sollevato interrogativi profondi sull'uso dell'AI in contesti umani delicati.

L'annuncio di lavoro pubblicato da Microsoft pochi giorni dopo, volto a trovare nuovi grafici, ha ulteriormente alimentato le critiche. L'immagine generata male dall'AI e l'ironia di cercare nuovi talenti dopo una serie di licenziamenti hanno messo in luce un cortocircuito tra tecnologia e umanità. La proposta di affidare momenti di crisi personale a un chatbot non solo denota cinismo, ma rappresenta una pericolosa normalizzazione della deresponsabilizzazione aziendale, spostando il peso del disagio sociale sugli individui.

L'automazione e il bias che ne deriva, chiamato automation bias, portano le persone a fidarsi eccessivamente dei sistemi automatizzati, soprattutto in momenti di vulnerabilità. Questo approccio non solo minimizza l'importanza del supporto umano, ma rischia di amplificare il disagio emotivo in chi è già vittima di un sistema lavorativo disumanizzante. La soluzione AI, apparentemente semplice, si rivela spesso inadatta e pericolosa, richiedendo una riflessione più profonda sulle implicazioni etiche e sociali della tecnologia nel mondo del lavoro.

In questa Puntata

Microsoft licenzia e consiglia l'AI per superare il trauma: geniale o disumano?